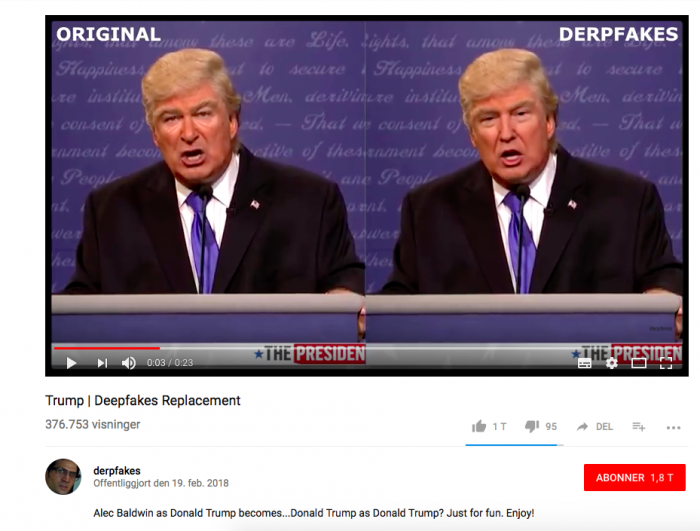

(Foto: DerpFake (YouTube) © DerpFake (screendump))

Med tre simple trin kan du nu sætte nye ansigter ind i hvilken som helst videooptagelse. Det lover virksomheden bag det nye program FakeApp.

Her finder danskerne sine nyheder

- 84 procent af de adspurgte danskere har brugt online medier, inklusiv sociale medier, til at tjekke nyheder

- 73 procent af de adspurgte danskere har brugt TV, til at tjekke nyheder

- 56 procent af de adspurgte danskere brugte de sociale medier til at finde nyheder

- 44 procent af de adspurgte fordelt på alle lande bruger Facebook som formidler af nyheder

Kilde: Reuters institute

Det vil sige, at du hverken skal være uddannet i special effects eller være den største haj inden for teknik for at kunne lave realistiske billeder og videoer af personer med andre ansigter end deres eget.

Programmet er endnu kun brugt til parodier og porno, siger Lars Konzack, lektor i Informationsvidenskab på Københavns Universitet, og henviser til den flittige brug af teknologien i porno, hvor både Taylor Swift og Emma Watsons ansigt er brugt i sexscener uden samtykke fra skuespillerne.

Teknologien kan bruges til sjov, og du kan se dine yndlingsskuespillere i scener, du ikke havde turdet drømme om, men teknologien kan misbruges og have vidtrækkende konsekvenser.

Læs også: I en tid, hvor fake news vokser, må journalister spidse blyanten

– Det problematiske består i, hvis programmet misbruges og bliver brugt til propaganda og til at fremstille en falsk virkelighed, som folk vælger at tro på. Det er ikke fordi, at manipulation ikke har fundet sted før i verdenshistorien, men denne metode gør det nemmere, og det kan have store politiske konsekvenser, siger Lars Konzack.

Mennesker er visuelle væsner, og hvis vi hele tiden skal gå rundt og stille spørgsmålstegn ved, hvad vi ser, så får vi meget ondt i hovedet. Det vil altså blive meget svært at navigere rundt i samfundet.

Mark Blach-Ørsten, medieforsker på Roskilde Universitet

Kan du se forskel på den virkelige Donald Trump og den manipulerede version?

Vi tror på det, vi ser

Synet er en af menneskets primære sanser, og vi er visuelle væsner, og når vi ser billeder og videoer, så tror vi umiddelbart på det vi ser, fortæller Mark Blach-Ørsten, som er medieforsker på Roskilde Universitet.

– Der er en overvejende tendens til, at det medie, der opfattes som mest troværdigt, er TV. Dette er på trods af, det er nemmere at manipulere med TV end skrift, hvor billeder og lyd nemt kan skiftes ud. Vi tror altså på det, vi ser. Det sker helt intuitivt og instinktivt, siger Mark Blach-Ørsten.

– Mennesker er visuelle væsner, og hvis vi hele tiden skal gå rundt og stille spørgsmålstegn ved, hvad vi ser, så får vi meget ondt i hovedet. Det vil altså blive meget svært at navigere rundt i samfundet, siger Mark Ørsten.

Internettet vrimler med videoer af de såkaldte “Face Swaps” Her bliver Kate McKinnon til Hillary Clinton. Ville du kunne se forskellen?

Kritikken skal sættes på autopilot

Fake News bliver hovedsagligt delt på de sociale medier. Det værste der kan ske, og det vi skal frygte allermest med den nye teknologi er, at Fake News bliver delt endnu mere, siger Mark Blach-Ørsten

De sociale medier er danskernes foretrukne kanal til at blive opdateret på dagens nyheder, viser rapport fra Reuters Institute 2016. Danskernes brug af de sociale medier og de falske nyheders omløb kulminerer i en situation, hvor brugernes kritiske sans skal aktiveres.

– Vi skal som samfund have fundet en metode til at håndtere teknologien, og de problemer som følger med, fordi teknologien findes, og vi kan ikke trække den tilbage, forklarer Lars Konzack.

Mark Blach-Ørsten mener også, at vi skal oparbejde en metode til at håndtere teknologien. Han har et bud på, hvordan vi skal håndtere det:

– Vi skal have oparbejdet en form for “automatkritik”, når vi ser bestemte ting på bestemte måder. De sociale medier har været udsat for intens kritik de sidste to år, og jeg håber derfor også, at brugerne også vil være mere kritiske over for det, de ser på disse platforme, siger Mark Blach-Ørsten.

Sådan gjorde vi: Idéen til artiklen stammer fra journalistens undren over programmet FakeApp, og hvilke konsekvenser denne kan have for samfundet. DR har lavet en artikel om fænomenet DeepFake og denne artikel behandler DeepFake i et konkret program. Journalisten har været i kontakt med Lars Konzack over telefon, og interviewet Mark Blach-Ørsten personligt. Tallene om danskernes brug af nyheder er fundet i rapporten, der er linket til i artiklen.